기계는 왜 학습하는가

3월 15, 2026

저자(Author) : 아닐 아난타스와미 Anil Ananthaswamy

▩ 개 요

과학 전문 저널리스트 ‘아닐 아난타스와미(Anil Ananthaswamy)’의 저서 ‘기계는 왜 학습하는가(Why Machines Learn)’는 현대 사회를 뒤흔들고 있는 ‘인공지능(AI)’과 ‘머신러닝’의 이면에 숨겨진 수학적 원리와 그 역사적 흐름을 추적하는 책입니다. 저자는 인공지능을 단순한 마법처럼 묘사하는 대신, 그 뿌리가 되는 수학의 아름다움과 논리를 통해 독자들이 AI의 본질을 이해하도록 돕습니다.

▩ 주 제

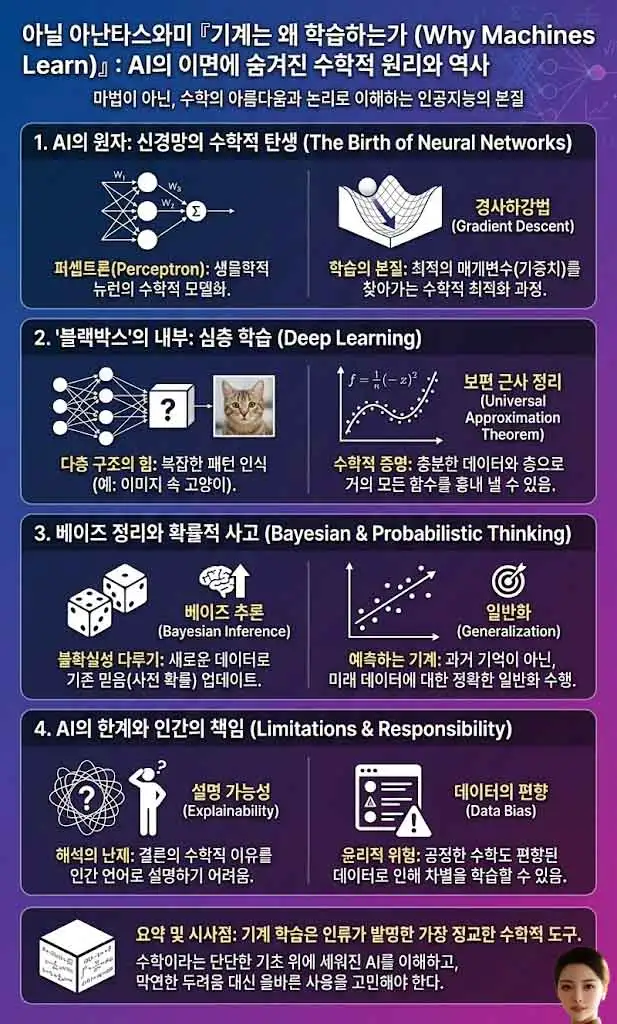

1. AI의 원자: 신경망의 수학적 탄생

책은 1940년대와 50년대로 거슬러 올라가 인공지능의 가장 기초적인 단위인 ‘퍼셉트론’의 탄생부터 시작합니다.

- 생물학에서 수학으로: 인간의 뉴런이 작동하는 방식을 모방하려 했던 초기의 시도가 어떻게 수학적 모델로 변환되었는지 설명합니다.

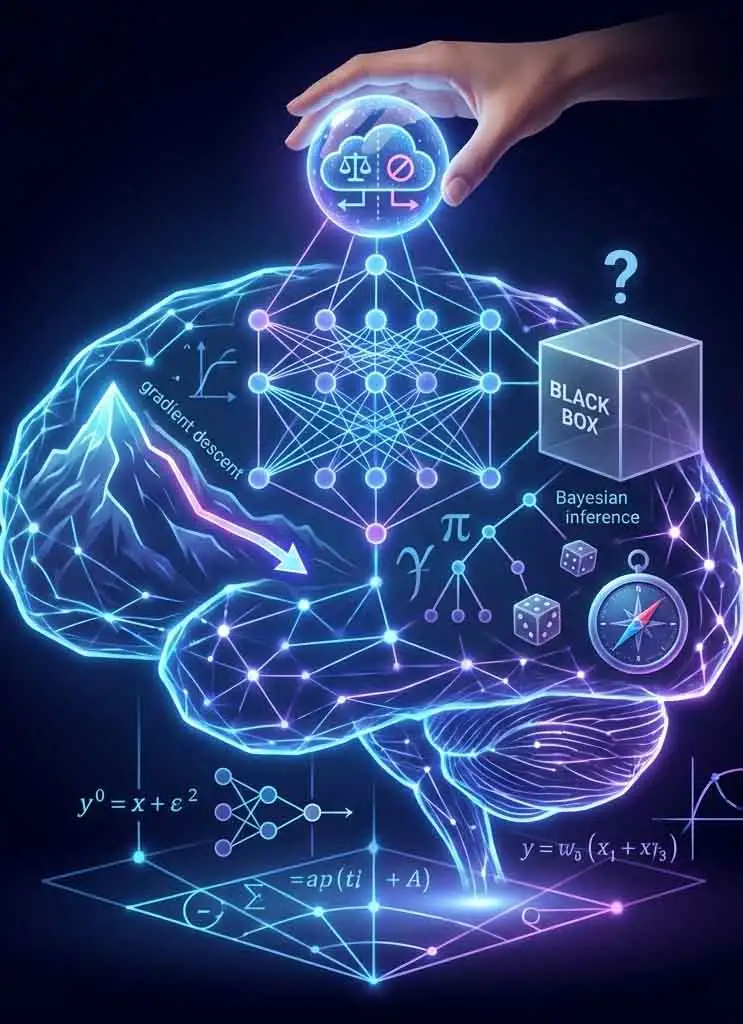

- 학습의 본질: 기계가 ‘학습’한다는 것은 결국 데이터 사이의 관계를 가장 잘 설명하는 함수의 매개변수(가중치)를 찾아가는 과정임을 밝힙니다. 저자는 이를 산의 정상에서 가장 가파른 길을 내려오는 ‘경사하강법’과 같은 수학적 최적화 개념으로 쉽게 풀어냅니다.

2. ‘블랙박스’의 내부: 심층 학습(Deep Learning)

수십 년간의 정체기(AI의 겨울)를 지나 어떻게 기계가 비약적으로 발전했는지 다룹니다.

- 다층 구조의 힘: 신경망이 층층이 쌓이면서 단순한 선형 문제를 넘어 복잡한 패턴(이미지 속의 고양이, 언어의 문맥 등)을 인식하게 되는 과정을 추적합니다.

- 수학적 증명: 저자는 심층 신경망이 우수한 성능을 보이는 이유를 수학적으로 탐구합니다. 특히 ‘보편 근사 정리(Universal Approximation Theorem)’ 등을 언급하며, 충분한 데이터와 층이 있다면 신경망이 세상의 거의 모든 복잡한 함수를 흉내 낼 수 있음을 보여줍니다.

3. 베이즈 정리와 확률적 사고

책은 확정적인 논리뿐만 아니라, 불확실성을 다루는 확률론적 접근의 중요성을 강조합니다.

- 베이즈 추론: 기계가 새로운 데이터를 접할 때 기존의 믿음(사전 확률)을 어떻게 업데이트하는지 설명합니다. 이는 자율주행 자동차가 안개 속에서 물체를 판단하거나, 챗봇이 다음 단어를 예측할 때 필수적인 원리입니다.

- 예측하는 기계: 머신러닝의 목적은 과거를 기억하는 것이 아니라, 보지 못한 미래 데이터에 대해 얼마나 정확한 ‘일반화(Generalization)’를 수행하느냐에 있음을 역설합니다.

4. AI의 한계와 인간의 책임

마지막으로 저자는 수학적 완벽함 뒤에 숨은 실존적인 질문들을 던집니다.

- 설명 가능성(Explainability): 기계가 왜 그런 결론을 내렸는지 수학적으로는 알 수 있지만, 인간의 언어로 설명하기 어려운 ‘해석의 난제’를 다룹니다.

- 데이터의 편향: 수학은 공정하지만, 기계가 학습하는 데이터에 인간의 편견이 담겨 있을 때 발생할 수 있는 윤리적 위험을 경고합니다.

▩ 결 론

『기계는 왜 학습하는가』는 코딩 기술이나 최신 트렌드를 나열하는 책이 아닙니다. 대신 “기계 학습은 인류가 발명한 가장 정교한 수학적 도구“라는 사실을 입증하려 노력합니다. 수학이라는 단단한 기초 위에 세워진 AI를 이해할 때, 비로소 우리는 AI에 대한 막연한 두려움에서 벗어나 이 기술을 어떻게 올바르게 사용할지 고민할 수 있게 됩니다.

▩Contents <<< [기계는 왜 학습하는가]

- 제1장 패턴을 찾고 말 테다

- 제2장 여기에선 모두가 숫자에 불과하다

- 제3장 그릇의 바닥

- 제4장 십중팔구

- 제5장 유유상종

- 제6장 행렬에는 마법이 있다

- 제7장 커널 밧줄 탈출쇼

- 제8장 물리학의 소소한 도움으로

- 제9장 심층 학습의 발목을 잡은 사람(실은 아님)

- 제10장 오래된 신화를 깨뜨린 알고리즘

- 제11장 기계의 눈

- 제12장 미지의 땅

▩ 인용글(Quoted Passage) <<< [기계는 왜 학습하는가]

▶ 경사하강법(Gradient Descent)

아닐 아난타스와미의 저서 『기계는 왜 학습하는가』에서 다루는 ‘경사하강법(Gradient Descent)’은 현대 인공지능이 최적의 정답을 찾아가는 가장 핵심적인 ‘학습 방식’입니다. 이 개념을 시각적 비유와 수학적 원리를 통해 자세히 설명해 드리겠습니다.

1. 시각적 비유: 안개 낀 산 내려오기

경사하강법을 이해하는 가장 좋은 방법은 ‘안개가 자욱한 산 위에서 가장 낮은 골짜기(최저점)를 찾아 내려가는 조난자’를 떠올리는 것입니다.

- 지형 (손실 함수): 산의 높낮이는 인공지능의 ‘오차’를 의미합니다. 높은 곳은 오차가 큰 상태, 낮은 골짜기는 오차가 최소화된 상태입니다.

- 발바닥의 감각 (기울기/Gradient): 안개 때문에 앞이 보이지 않으므로, 조난자는 발을 사방으로 뻗어 가장 가파르게 깎여 내려가는 방향을 찾습니다. 이 ‘가파른 정도’가 수학에서의 기울기입니다.

- 보폭 (학습률/Learning Rate): 한 번에 얼마나 멀리 이동할 것인가를 결정합니다. 너무 크게 걸으면 골짜기를 지나쳐 버리고, 너무 작게 걸으면 내려가는 데 시간이 너무 오래 걸립니다.

2. 수학적 원리: 오차를 최소화하는 방향

인공지능 내부에서는 다음과 같은 단계로 경사하강법이 진행됩니다.

- 초기화: 가중치(W, 기계가 데이터에 부여하는 중요도)를 아무 숫자로 시작합니다. 산의 무작위 지점에 서 있는 것과 같습니다.

- 오차 계산: 현재 가중치로 예측을 해보고 실제 정답과 얼마나 차이가 나는지(Loss)를 계산합니다.

- 기울기 구하기: 수학적으로 현재 위치에서 오차가 줄어드는 방향(미분값)을 계산합니다.

- 가중치 업데이트: 오차가 줄어드는 방향으로 가중치를 조금 수정합니다.

- 반복: 오차가 거의 변하지 않을 때(골짜기 바닥에 도달할 때)까지 이 과정을 수천, 수만 번 반복합니다.

3. 학습률(Learning Rate)의 중요성

책에서도 강조하듯, 경사하강법에서 가장 중요한 매개변수는 학습률입니다.

- 학습률이 너무 높으면: 보폭이 너무 커서 최저점을 밟지 못하고 반대편 벽으로 튕겨 나갑니다. (발산/Divergence)

- 학습률이 너무 낮으면: 바닥까지 가는 데 수만 년이 걸릴 수 있고, 때로는 ‘지역 최저점(Local Minimum, 진짜 바닥이 아닌 작은 웅덩이)’에 갇혀 버리기도 합니다.

4. 왜 ‘기계 학습’의 핵심인가?

기계가 ‘학습’한다는 말은 곧 “수많은 데이터 속에서 오차라는 산의 지형을 탐험하며, 가장 낮은 바닥(정답)에 도달하는 가중치 세트를 찾아내는 것“을 의미합니다. 딥러닝에서 신경망이 아무리 복잡해져도, 그 밑바닥에는 항상 이 경사하강법이라는 수학적 엔진이 돌아가고 있습니다.

기계 학습은

인류가 발명한

가장 정교한

수학적 도구

<< 기계는 왜 학습하는가 >>

<< 같은 부류 Post(마침내 특이점이 시작된다’) 바로가기 >>

베스트셀러 [‘기계는 왜 학습하는가‘] ✈ 책으로 읽기를 권장합니다.

[…] 같은 부류 Post(‘기계는 왜 학습하는가’) 바로가기 […]